文章目录[隐藏]

近期 OpenClaw 的爆火,让不少朋友体验到了AI agent的强大与便捷。但随之而来的却是现实痛点:为了降低使用成本,很多朋友会从各类渠道收集免费的 AI 接口 Token,比如前篇文章提到的晴天AI,之前写过的openrouter等,可这些零散的 Token 不仅来源杂、有效期不一,还面临着调用量难统计、权限难管控、接口格式不统一的问题。比如不同模型的Token调用规则不同,手动切换接口地址和密钥耗时耗力;免费 Token 额度有限,稍不注意就会超出限制导致 OpenClaw 调用中断。

而 New API作为AI接口聚合管理平台,恰好解决了OpenClaw用户的 Token 管理难题:它能将所有免费 / 付费Token统一收纳,通过标准化的接口格式对接 OpenClaw,同时提供精细化的额度管控、调用统计、限流保护等能力,让大家无需再手动管理零散 Token,只需通过New API的统一令牌,就能让OpenClaw稳定调用各类AI模型,既盘活了零散的免费Token资源,又规避了Token管理混乱、调用失控的问题。

什么是New API?

New API 是基于One API二次开发的新一代大模型网关与 AI 资产管理系统,核心是为开发者 / 团队提供统一的大模型接口管理能力,只需对接这一个网关,即可无缝调用各类主流大模型接口,降低多模型集成与管理成本。

|

1 2 3 4 |

项目地址:https://github.com/QuantumNous/new-api 文档地址:https://docs.newapi.pro |

核心特性

-

体验与兼容:全新 UI、多语言支持,兼容原版One API数据库,迁移成本低; -

计费与管控:支持按调用次数收费、缓存计费、渠道加权随机分配,还有数据看板、令牌分组 / 模型限流、用户级限流等精细化管控能力; -

功能拓展:支持在线充值、密钥查额度,兼容 Rerank 模型、 OpenAI Realtime API、Claude Messages格式等,还可通过模型名称后缀自定义推理策略; -

部署与适配:支持 Docker/ 宝塔面板等多方式部署,适配OpenAI、Azure、Claude等数十种渠道,还可对接Midjourney-Proxy、Suno API等扩展能力; -

灵活易用:支持 LinuxDO、Telegram、OIDC等多授权登录,提供完整的接口文档与社区支持,仅需简单配置即可快速上手。

使用场合

-

个人 / 小团队 AI 接口管理:聚合多平台 API密钥,统一管理和分发,降低多供应商接口对接成本。 -

AI 服务二次分发:支持令牌额度管控、用户分组,适合小规模对外提供 AI 接口服务(需遵守合规要求)。 -

多场景 AI 能力调用:覆盖聊天、嵌入、音频、图像生成等需求,适配跨境业务(代理配置)、本地化部署等场景。 -

学习与自研适配:开源可定制,支持自定义模型价格、关键词安全检查、 Webauthn登录等,适合拿来学习和个性化改造。 -

轻量化部署需求:单可执行文件、 Docker一键部署,开箱即用,适合无复杂运维条件的个人 / 小团队快速落地AI应用。

Docker Compose 一键搭建

创建目录结构

安装之前需先在docker文件夹中新建一个new-api文件夹,用于配置持久化保存,后面所有相关文件都存在这里。

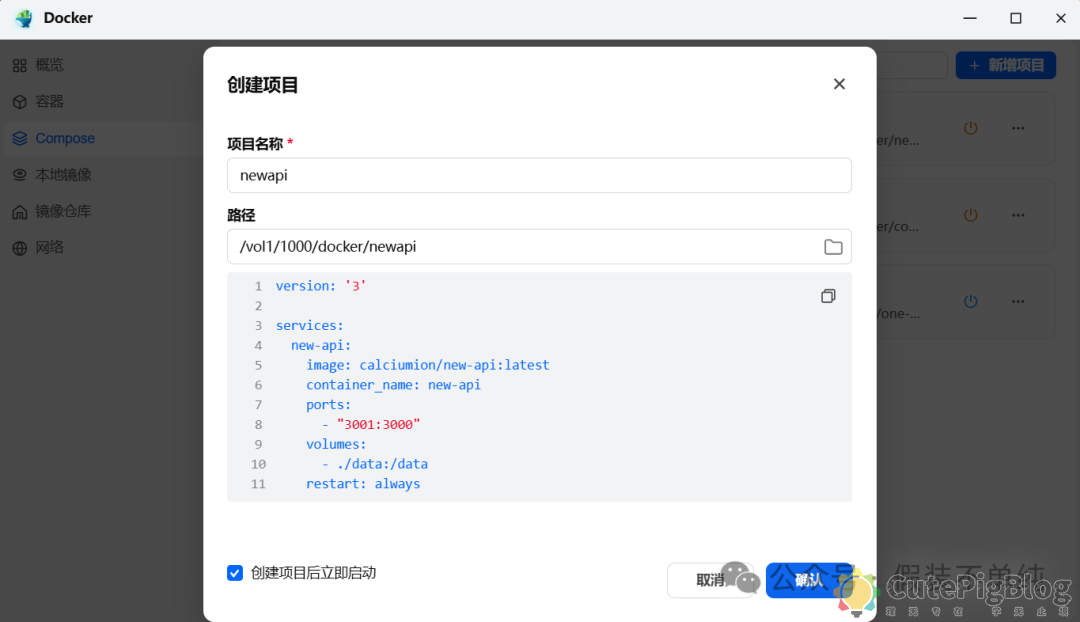

准备Compose文件

打开飞牛OS的docker--compose--新增项目--项目名称(填new-api,可识别即可),路径选择上面建立好的文件夹“new-api”,选择创建docker-compose.yml,然后将下面代码复制粘贴到代码框,为了便于大家理解,我给部分代码加了注释,最后勾上创建项目后立即启动,点击创建即可:

|

1 2 3 4 5 6 7 8 9 10 11 12 |

version: '3' services: new-api: image: calciumion/new-api:latest container_name: new-api ports: - "3001:3000" volumes: - ./data:/data restart: always |

❝部署注意事项: 端口可根据需要修改(如将 3001 改为 3002)。

显示正在运行,说明部署成功。

配置服务

启动成功后,访问http://服务器IP:3001即可进入 new-api 登录页面

这个是个提示,咱们是建了文件夹,做了持久化映射的,下一步确认就行,接下来就是设置管理员账号密码,。

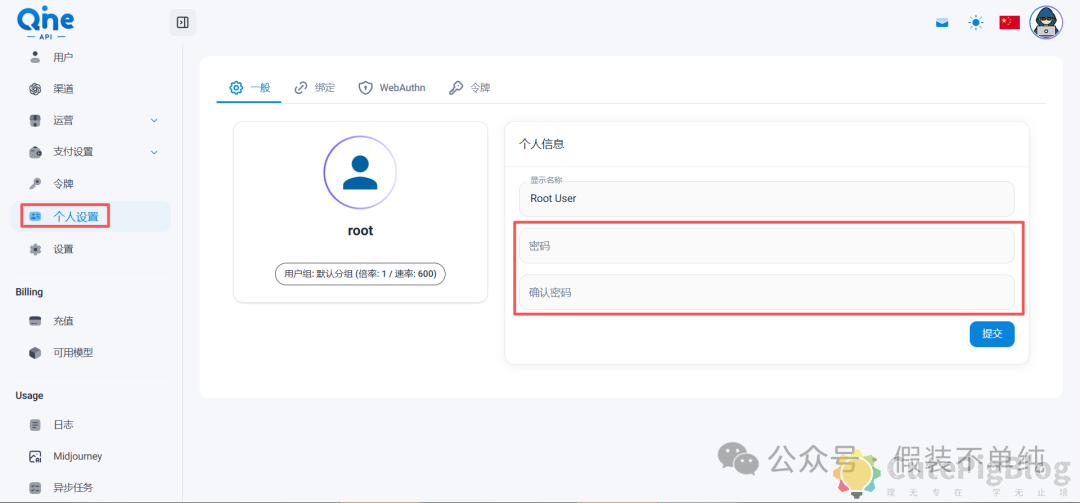

进入 “个人设置” 页面,修改初始密码,避免调用凭证泄露。

选择模式,我是自己用,就选自用模式

完成设置,初始化系统。

初始化完成,进入主页,用我们刚刚设置的密码登录就行。

添加 AI 渠道

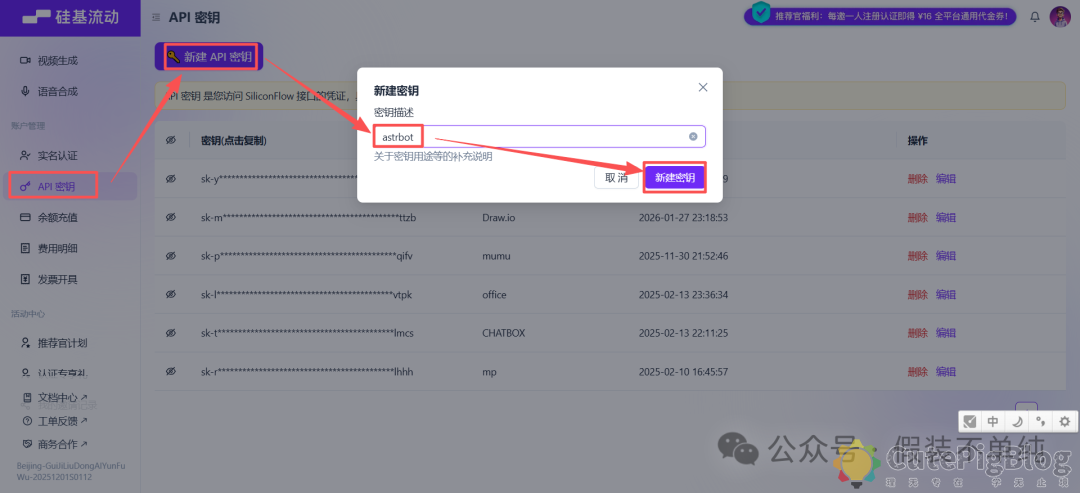

渠道是 NewAPI对接底层 AI 模型的核心,以添加我在OpenClaw常用的硅基流动渠道为例,需要先注册并申请个key,使用我的硅基流动邀请注册地址,注册后系统会自动赠送16元代金卷,足够体验使用了。

|

1 2 |

注册地址: <a href="https://cloud.siliconflow.cn/i/pOJCrYm8" target="_blank" rel="noopener">https://cloud.siliconflow.cn/i/pOJCrYm8</a> |

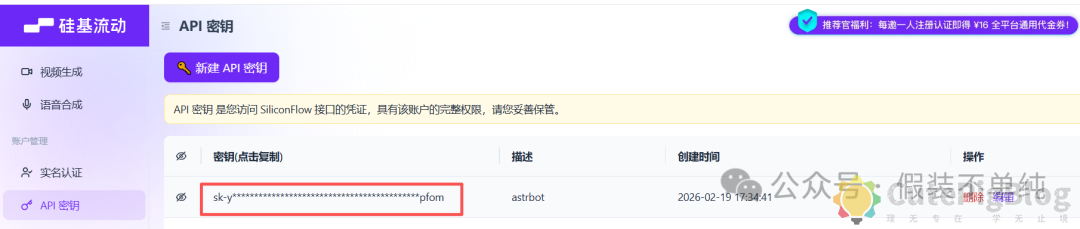

用手机号注册并登录,进入【控制台】→【API密钥】。 点击“创建API密钥”,给密钥起个名字(比如“bot”).

创建后复制保存密钥(类似“sk-xxxxxx”的字符串),这个后面要用到,别弄丢了!

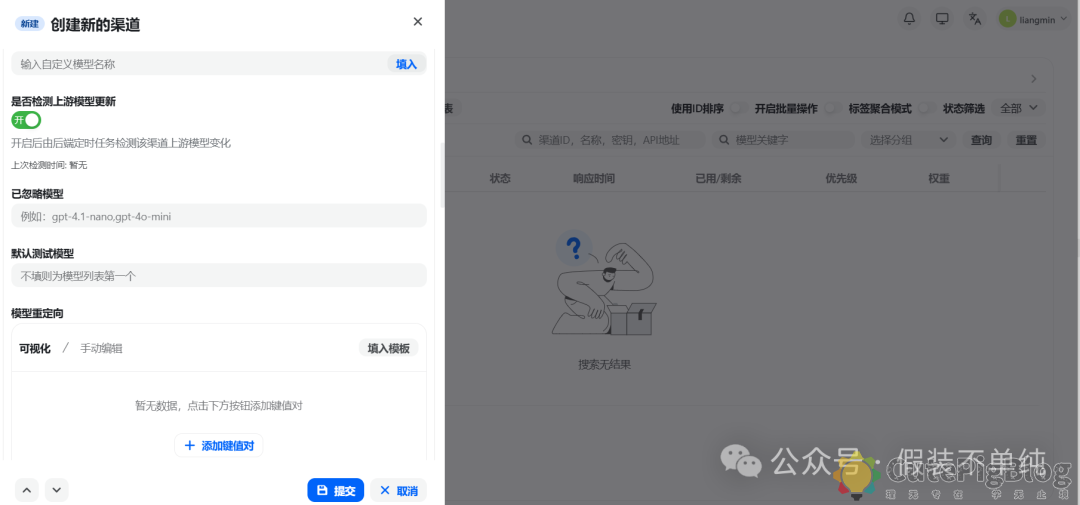

然后回到New API,点击左侧菜单栏 “渠道管理”→“添加渠道”;

填写渠道信息:

|

1 2 3 4 5 6 7 |

- 类型:下拉选择(比如我这里就选Siliconlfow); - 名称:自定义(如 “openclaw调用”); - 密钥:填写你上面获取的API Key; - 渠道API地址:这个是用于自定义的,类型下拉选项没有的才填,有的不填; - 用户组:默认default就行 - 其他配置:默认就行; |

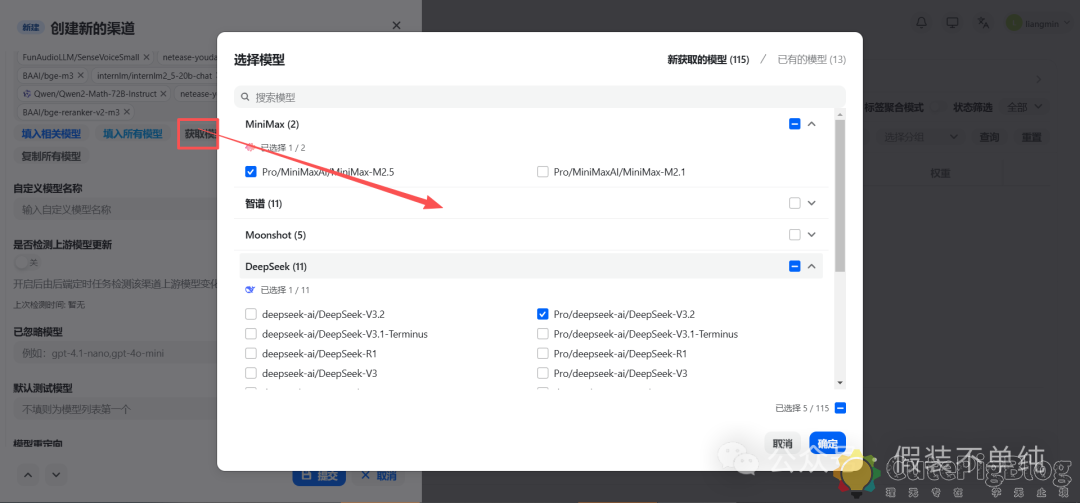

特别要说一下模型:这里需要先填入上面获取的APIkey,然后点获取模型列表。

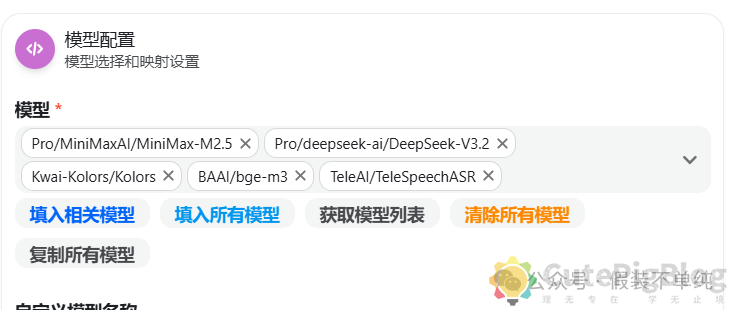

建议选几个你常用的模型就行,比如我推理模型就选了deepseekv3.2,MiniMax-M2.5,生图模型选了Kwai-Kolors/Kolors,嵌入模型选了一个BAAI/bge-m3,语音模型选了TeleAI/TeleSpeechASR,后面三个都是免费,选好后就是这样.

点击 “提交”,渠道添加完成。

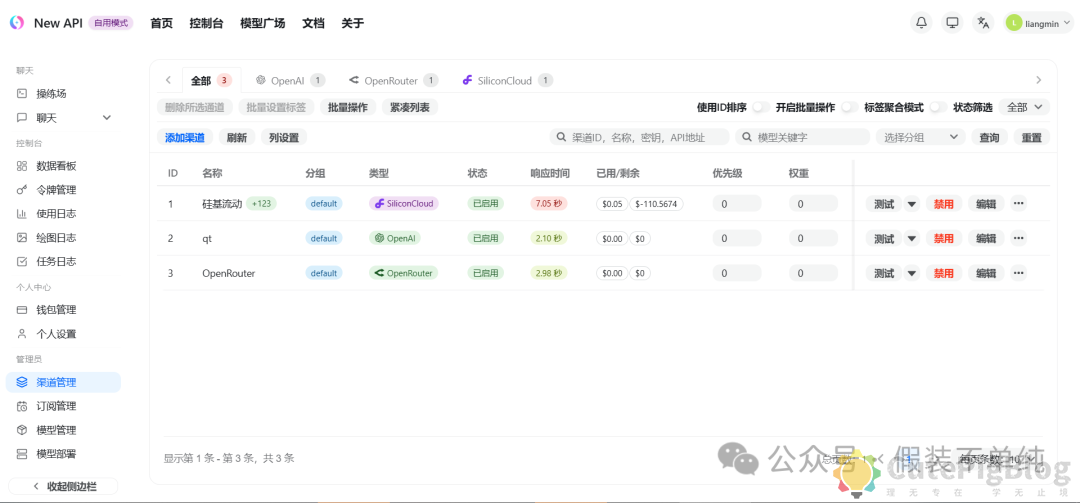

然后回到面板就可以看到我们的渠道了,点击后面的测速,就可看到模型的响应时间。

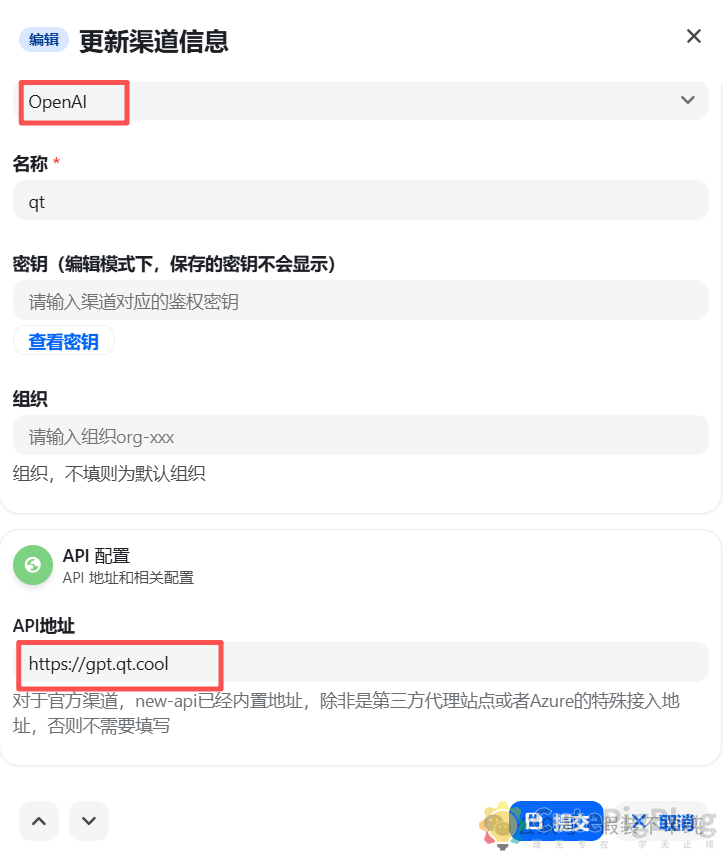

接下来陆续配置了晴天的免费模型,要注意的是这个ai在填的时候类型要选择OpenAI,API地址不需要加/v1,模型名称需要复制添加上去,这个ai我选了GPT-5.2和GPT-5.2-Codex。关于晴天的模型,这个文章末尾有介绍:OpenClaw 企业微信渠道接入:从创建机器人到配对成功完整部署实战

然后是openrouter的模型,这个在类型里面有,直接选就行,填个key就行了,连API地址都不要。这个模型我只选了个stepfun/step-3.5-flash:free。关于这个模型,可参考前端仔的文章:openclaw 太耗Token?不用担心,免费🦞虾粮慢慢玩儿。

配置好后就是这3个,足够我使用了。

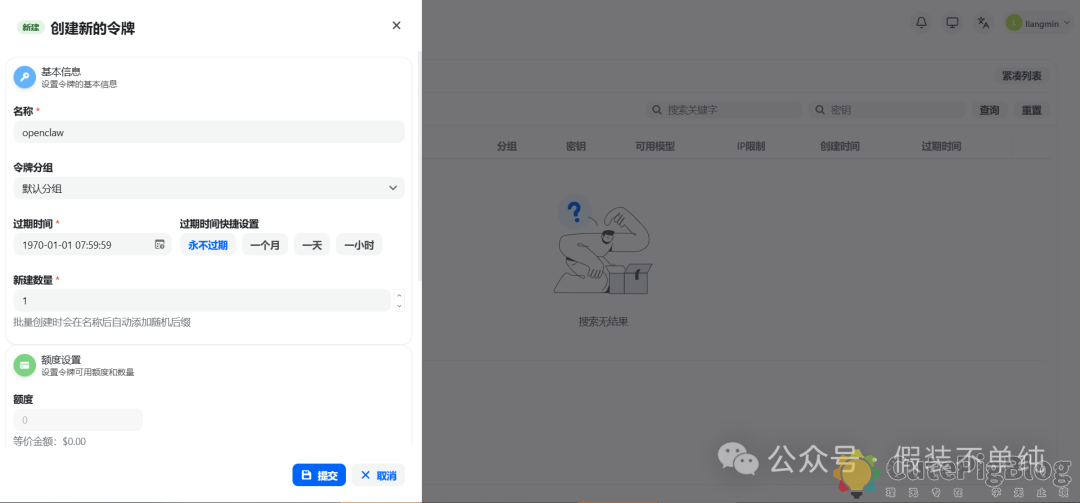

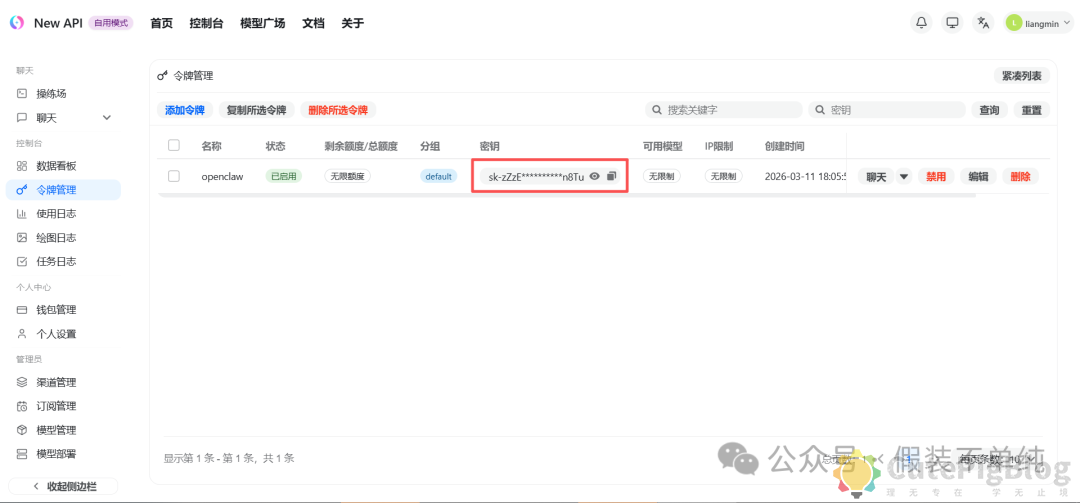

创建访问令牌

令牌是 OpenClaw 等应用调用 new-api 聚合接口的凭证,支持按用户 / 分组管控权限:

-

点击左侧菜单栏 “令牌管理”→“添加令牌”;

-

填写令牌信息: -

名称:自定义(如 “ OpenClaw- 调用令牌”); -

有效期:自定义(如永不过期、或自己选择过期时间); -

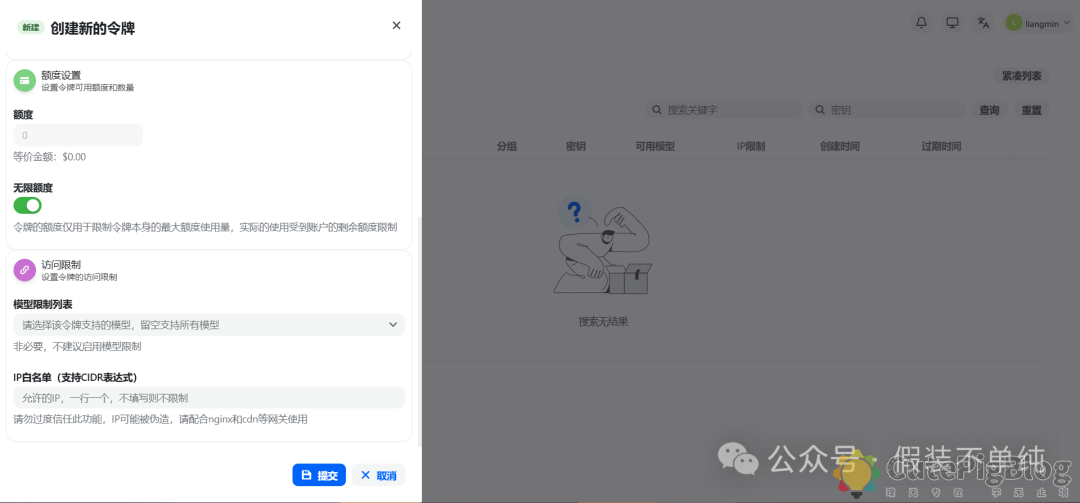

额度:自定义(如无限额度、5毛钱的);

-

|

1 2 3 |

- 选择分组:选择对应分组(可在 “用户组” 中提前配置专属的调用权限 / 额度、RPM 限制); - 权限范围:可限制可调用的模型; |

-

点击 “提交”,生成令牌,回到桌面可以看到列表,可以看到上方有令牌生成(格式类似 sk-xxxx),该令牌将作为调用new-api的凭证。

测试接口调用

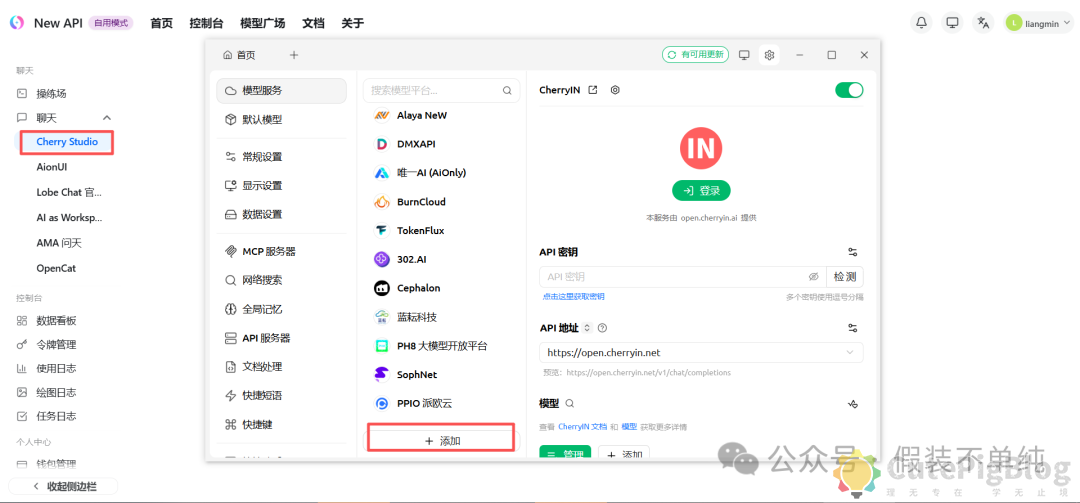

局域网使用

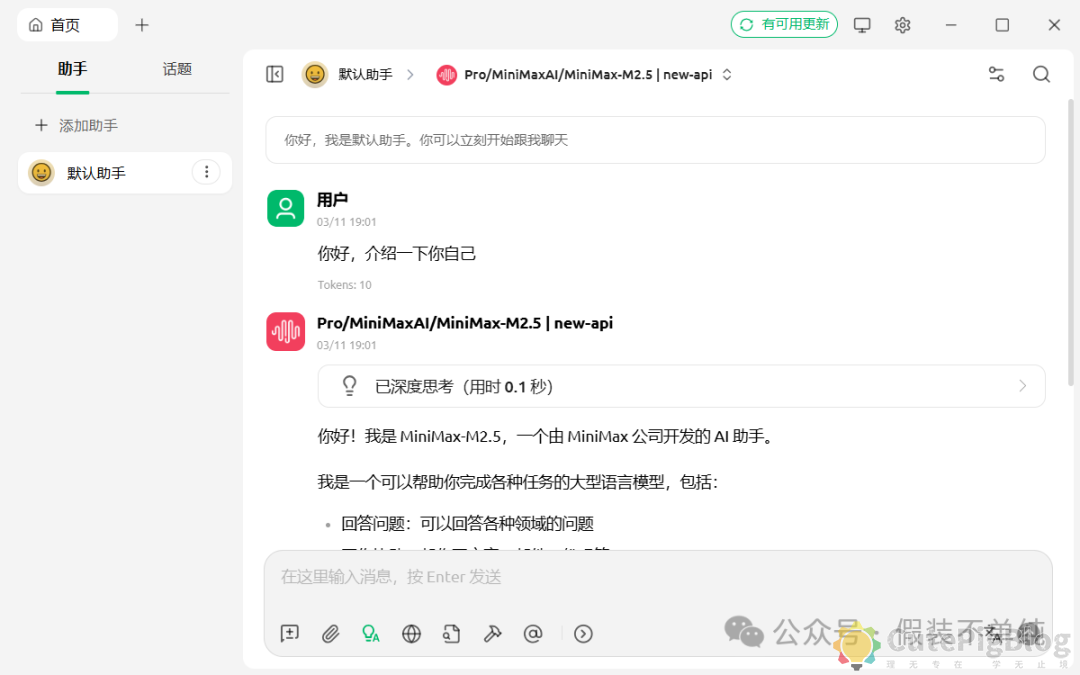

目前new-api已经支持调用cherry studio了,直接在聊天窗口点击就行,会直接调用你电脑上安装的cherry studio,点击添加,没安装也没关系,你选择其他方式测试也行。

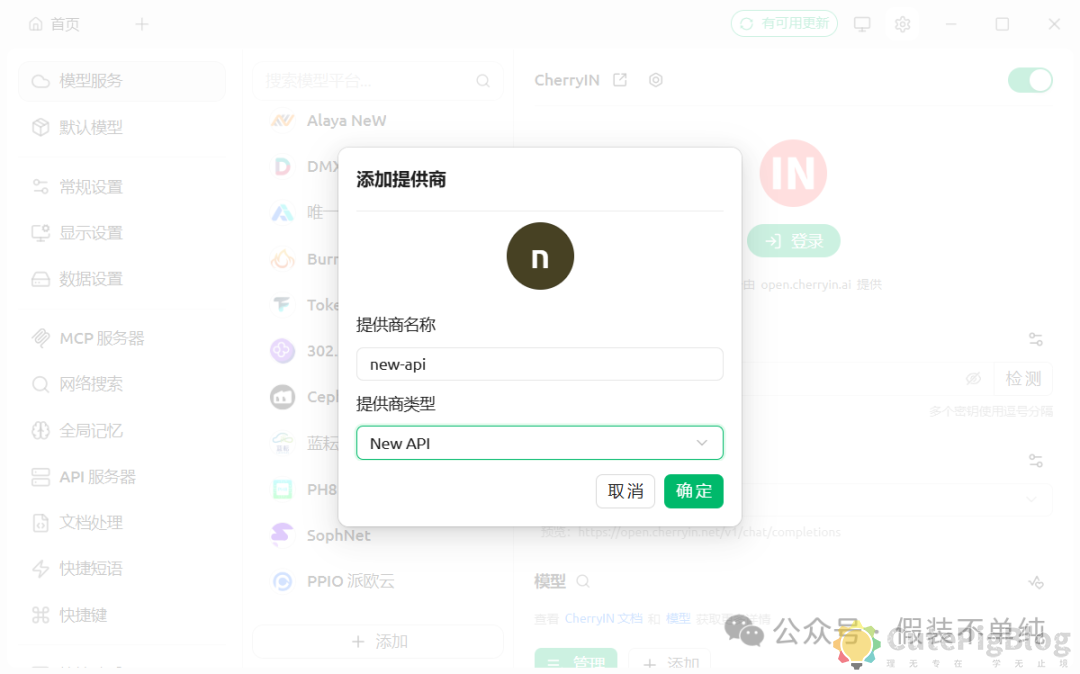

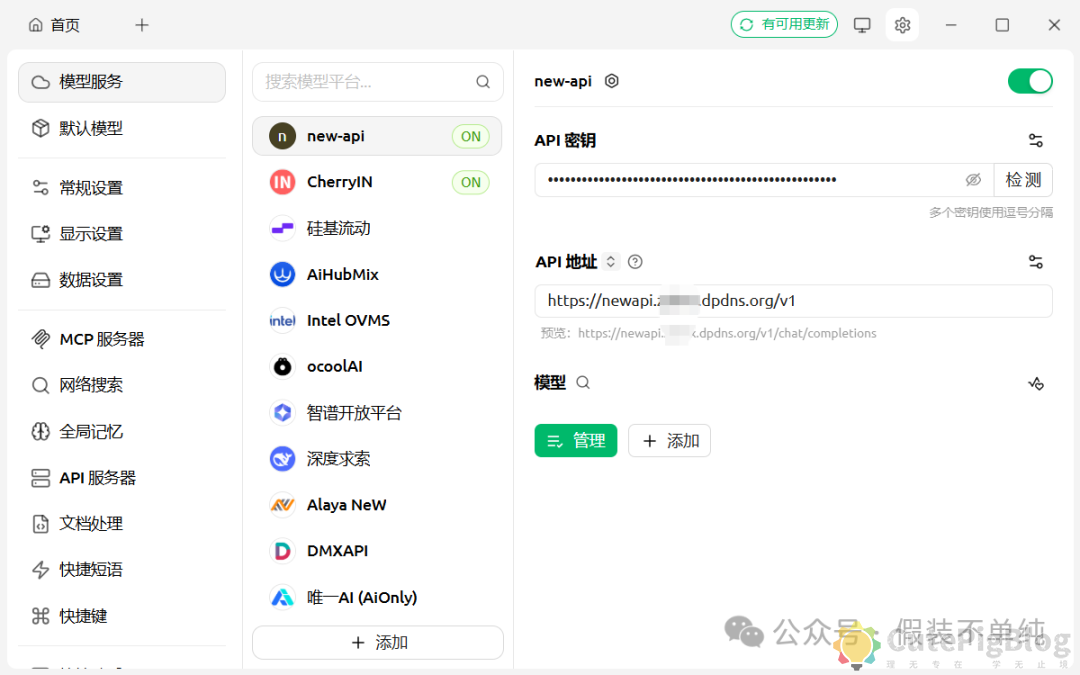

提供商名称填newapi,提供商类型可以直接下拉选择New-API

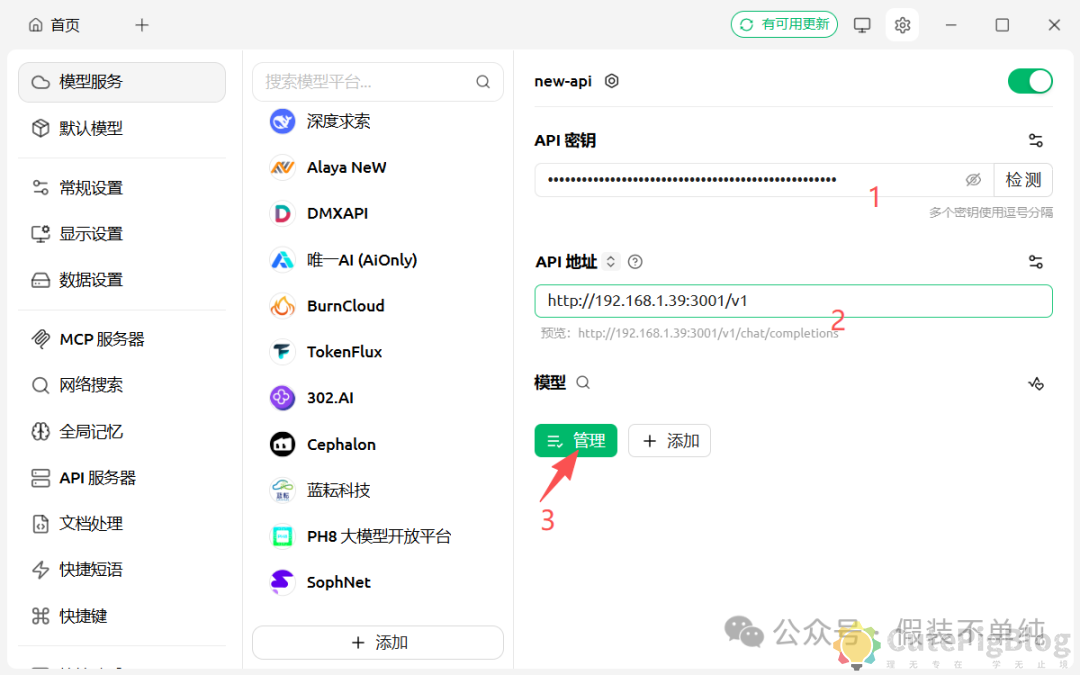

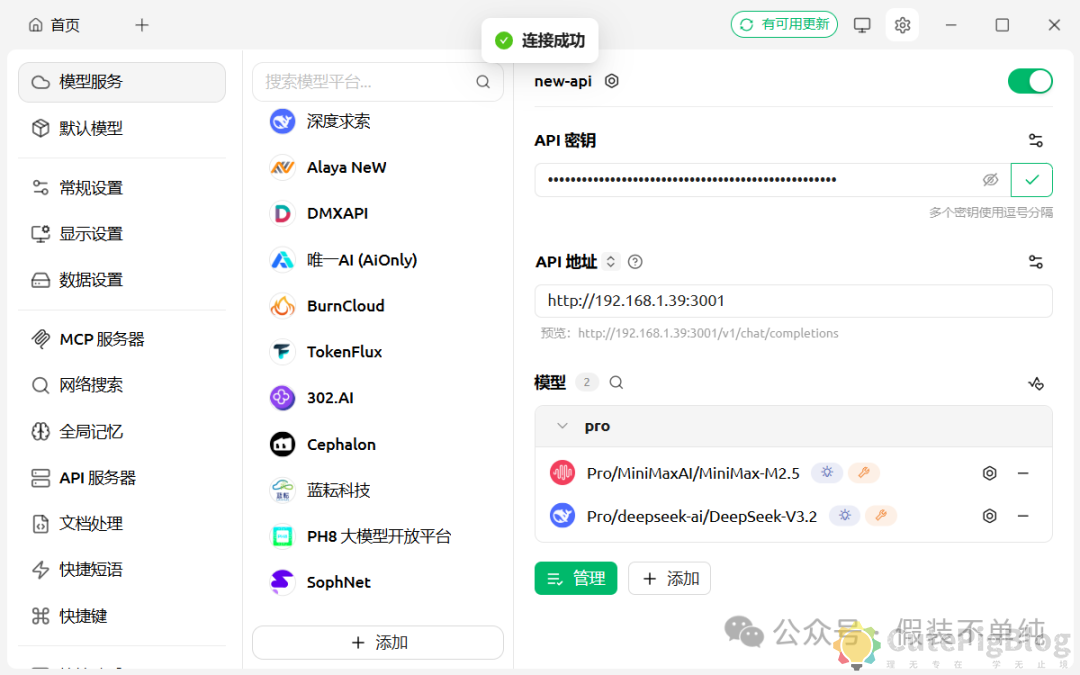

API 密钥那里填好前面New-API生成的令牌,api地址填http://192.168.1.39:3001,

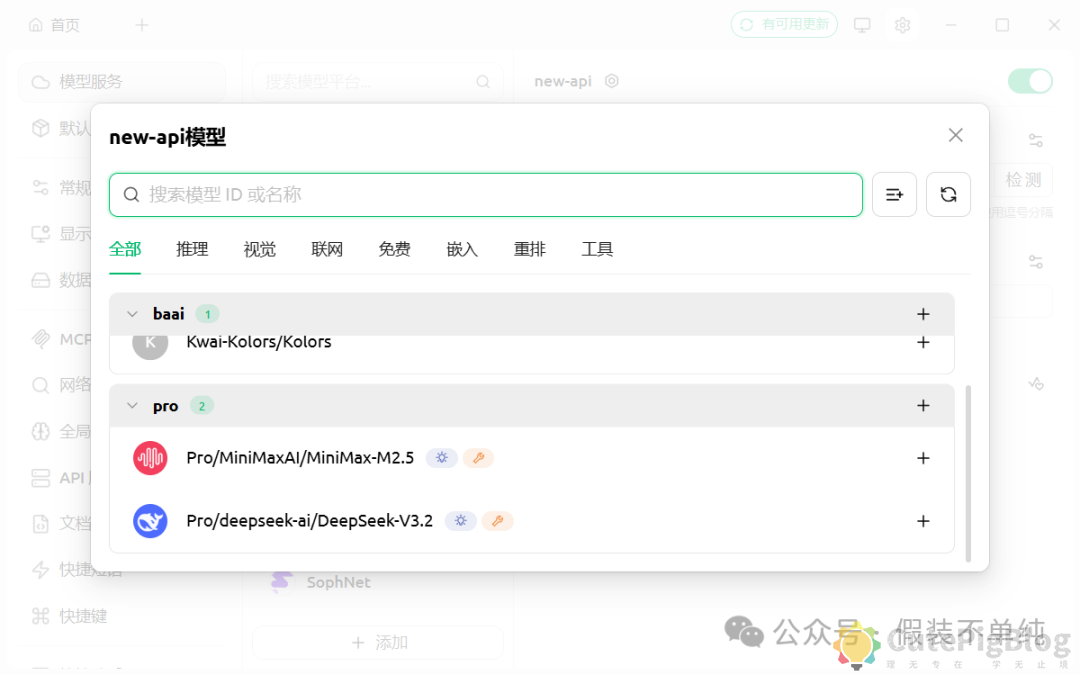

然后点击管理后就可以看到我们在new-api添加的模型了,再点模型名字后面的加号就可以添加模型。

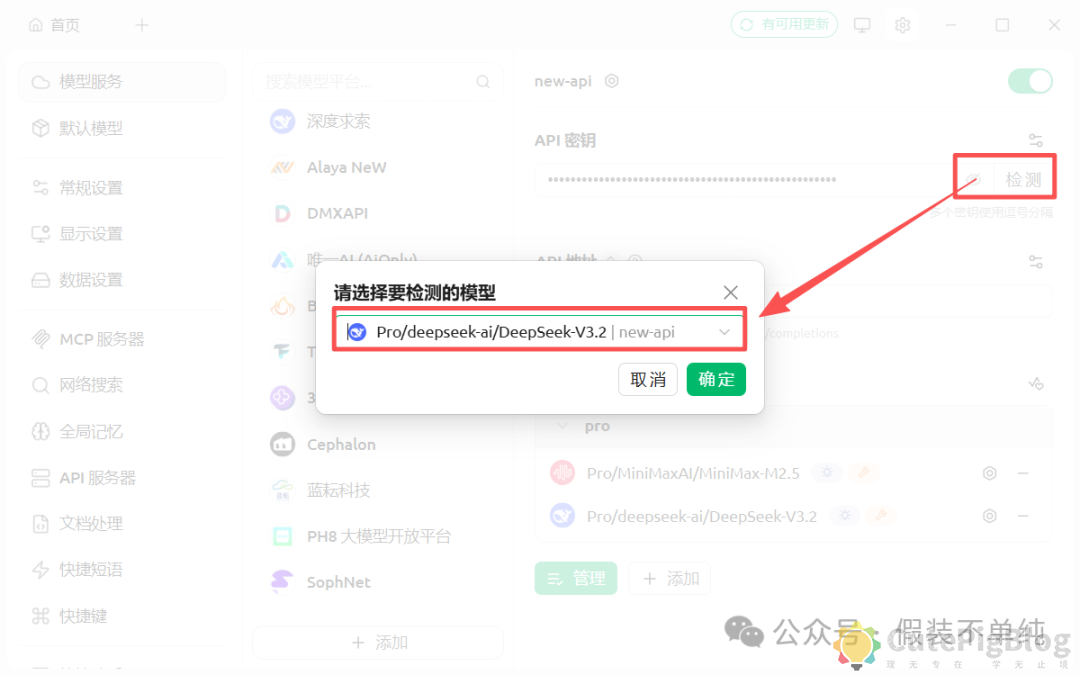

点击令牌右边的检测,选个模型来检测。

可以看到显示连接成功。

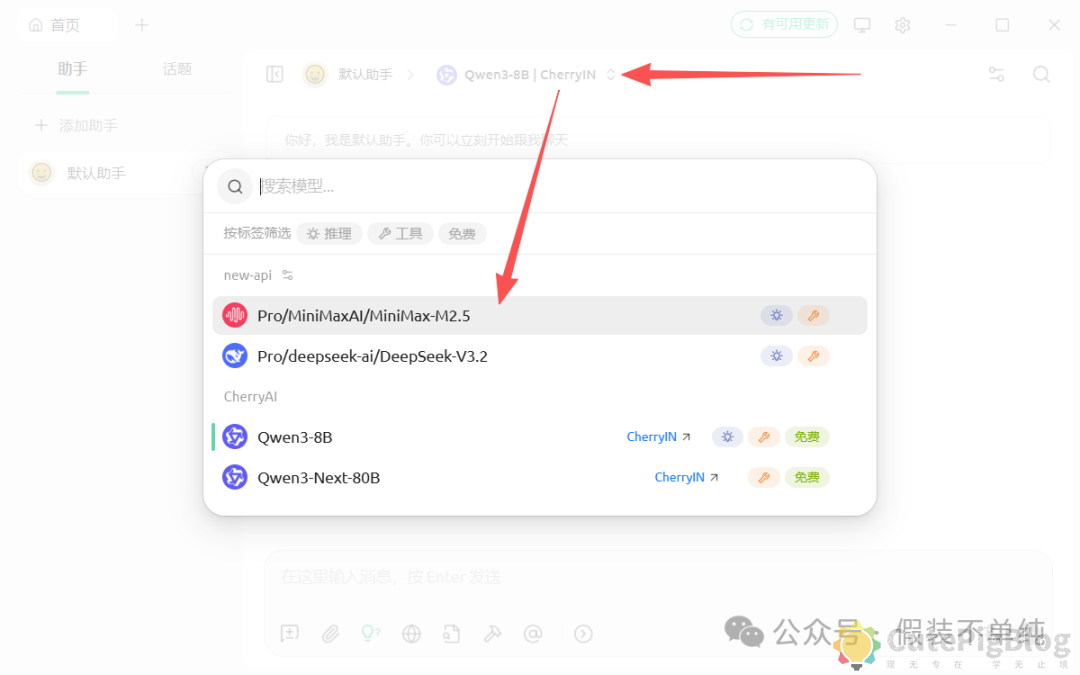

回到首页,在上面选择模型,就能切换你要使用的模型了。

非常好用。

非常好用。

当然,此时你也可以把你的模型配置到openclaw里面使用。在 openclaw.json 里补充或修改以下片段:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 |

{ models: { mode: "merge", providers: { newapi: { baseUrl: "https://your-newapi-domain.com/v1", apiKey: "NEWAPI_API_KEY", api: "openai-completions", models: [ { id: "gemini-2.5-flash", name: "Gemini 2.5 Flash" }, { id: "kimi-k2.5", name: "Kimi K2.5" }, ], }, }, }, agents: { defaults: { model: { primary: "newapi/gemini-2.5-flash", fallbacks: ["newapi/kimi-k2.5"], }, models: { "newapi/gemini-2.5-flash": { alias: "flash" }, "newapi/kimi-k2.5": { alias: "kimi" }, }, }, }, } |

当然,最简单的办法还是将下面的这段话按你的配置修改后发给openclaw,让它自己改,baseurl最好是域名,局域网使用太局限了。

|

1 2 3 4 5 6 7 |

请帮我配置并在测试成功后切换为以下模型: baseUrl: http://192.168.1.39:3001/v1 apiKey: "你的API_KEY", api: openai-completions, models id: Pro/DeepSeek-ai/DeepSeek-V3.2, name: deepseekv3.2 |

外网使用

上面讲的是在局域网内使用,但是如果没公网又想异地使用,比如我上班在公司部署了一个小龙虾,想使用部署在家里的new-api,可以用cloudfare tunnels 打隧道或者使用节点小宝生成域名极空间里的节点小宝:无公网IP也能内网穿透,远程访问NAS!、星空组网组成大内网等多种方式来使用。

我这里就是使用cloudfare tunnels 打隧道来用的。

填进来后也是能够获取到模型并使用。

七、结语

OpenClaw 的走红,本质是大家对AI的需求爆发,或许在实际生产中还不一定能用上,但是也极大的推动了大家在思想层面的接受程度,至少了解了,原来ai还可以做这么多事。对于普通人而言,现在就是大概体验一下,网络上现在免费的key也基本满足需求了,而 New API是为 OpenClaw 这类应用量身打造的AI能力底座,极大的减小了大家的使用成本,提高了使用体验。

浏览量: 64